Irán no solo está resistiendo en el frente militar: sus ataques cibernéticos en todo el mundo siguen hiperactivos

TECNOLOGIA20/03/2026El ataque a Stryker muestra impacto real con cirugías reprogramadas

Probablemente te haya pasado. Subes un PDF a un chatbot de inteligencia artificial con la esperanza de que te resuma un informe, te extraiga una tabla o te encuentre un dato concreto en cuestión de segundos. Y, a veces, lo consigue. Pero otras, el resultado es desconcertante: columnas mezcladas, notas al pie incrustadas en mitad del texto, tablas convertidas en un bloque ilegible o respuestas que no reflejan fielmente lo que pone el documento. La paradoja es evidente. Sistemas que ya demuestran avances claros en matemáticas y programación siguen tropezando con algo tan cotidiano como un PDF. Y ahí hay más que un simple fallo puntual.

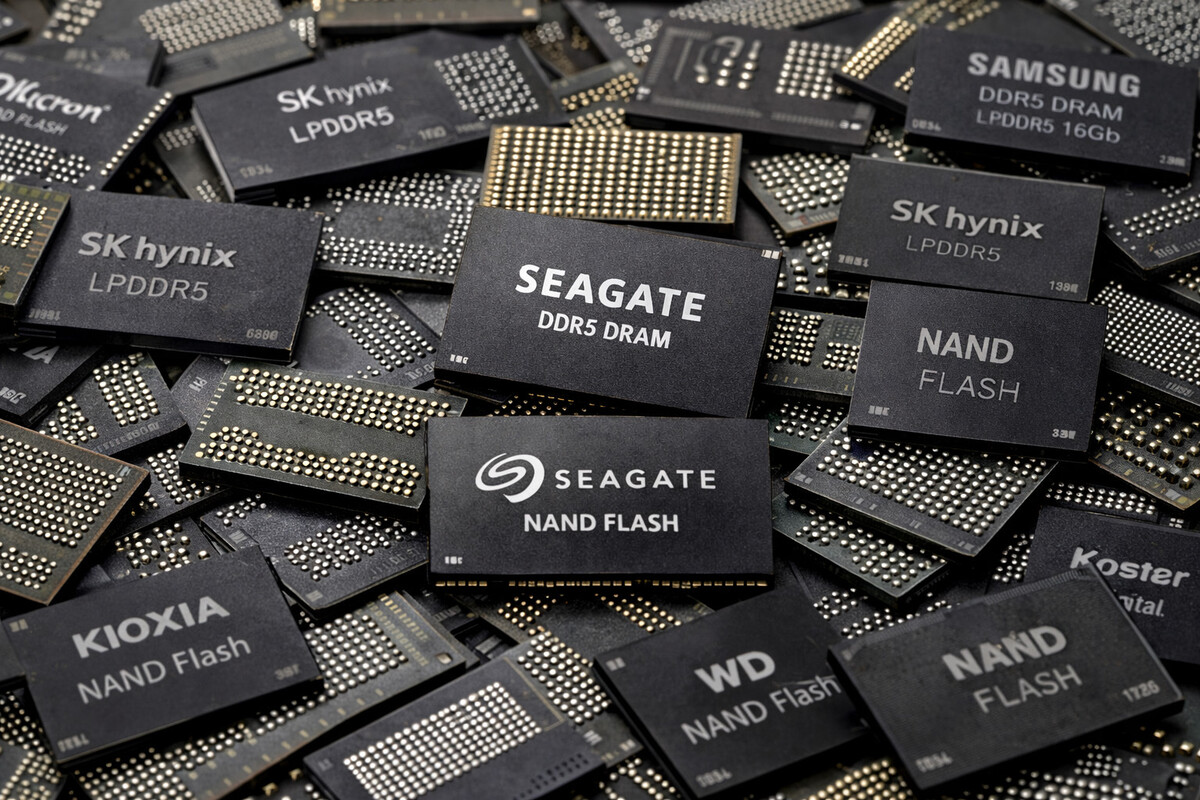

Cambio de mentalidad. Aunque para nosotros sea un documento con párrafos, títulos y tablas bien definidos, para el sistema que lo procesa la situación puede ser muy distinta. El PDF es, ante todo, una forma de describir visualmente cómo debe representarse una página. Y cuando un chatbot como Gemini o ChatGPT intenta trabajar con él, no siempre accede a una estructura ordenada, sino a un conjunto de instrucciones gráficas que primero debe reconstruir antes de poder responder con coherencia. Y esa diferencia se entiende mejor cuando miramos cómo “guarda” la información un PDF.

Cómo organiza realmente la información. A diferencia de una página web, donde el contenido sigue un orden lógico definido en el código, un PDF puede almacenar el texto como fragmentos independientes colocados en posiciones concretas de la página. Muchas veces, el archivo conserva coordenadas e instrucciones de colocación, pero no necesariamente relaciones explícitas entre una frase y la siguiente. Eso implica que el orden en el que “aparece” el texto al extraerlo no siempre coincide con el orden en que lo leemos. Si el documento incluye varias columnas, cuadros o elementos superpuestos, el sistema debe deducir cómo encajan entre sí. Y esa deducción no siempre es trivial.

Lo que ocurre con HTML. En una página web, el contenido está organizado en una jerarquía explícita: hay etiquetas que indican qué es un título, qué es un párrafo, qué es una tabla y cómo se relacionan entre sí esos elementos. Esa estructura forma parte del propio archivo y facilita que otros sistemas lo lean, lo indexen y lo procesen. En un PDF, como hemos visto, esa capa semántica puede no existir o no estar claramente definida. Por eso, en la práctica, extraer información de una web tiende a ser un proceso más predecible, mientras que hacerlo desde un PDF es todo más complicado.

Entonces, ¿qué pasa con el OCR? Es la primera solución que viene a la cabeza. Si el problema es que el texto no está bien estructurado o incluso está “dibujado” como una imagen, el reconocimiento óptico de caracteres debería convertirlo en algo legible para la máquina. Y en parte lo hace. El OCR se usa desde hace décadas para transformar imágenes de palabras en texto, pero convertir una imagen en texto no equivale a reconstruir la lógica del documento. Cuando hay elementos variados, el sistema puede reconocer cada palabra sin saber exactamente cómo encajan entre sí. El resultado no es un fallo en la lectura de caracteres, sino en la organización de la información.